Двумерной называют случайную величину

, возможные значения

которой есть пары чисел

. Составляющие

и

, рассматриваемые

одновременно, образуют систему двух случайных величин. Двумерную величину

геометрически можно истолковать как случайную точку

на плоскости

либо как случайный вектор

.

Дискретной называют двумерную величину, составляющие которой дискретны.

Закон распределения дискретной двумерной СВ.

Безусловные и условные законы распределения составляющих

Законом распределения вероятностей двумерной случайной величины называют соответствие

между возможными значениями и их вероятностями.

Закон

распределения дискретной двумерной случайной величины может быть задан:

а) в

виде таблицы с двойными входом, содержащей возможные значения и их вероятности;

б) аналитически, например в виде функции распределения.

Зная

закон распределения двумерной дискретной случайной величины, можно найти законы

каждой из составляющих. В общем случае, для того чтобы найти вероятность

, надо просуммировать

вероятности столбца

. Аналогично сложив

вероятности строки

получим вероятность

.

Пусть

составляющие

и

дискретны и имеют соответственно следующие

возможные значения:

;

.

Условным распределением составляющей

при

(j сохраняет одно и то же

значение при всех возможных значениях

) называют совокупность

условных вероятностей:

Аналогично

определяется условное распределение

.

Условные

вероятности составляющих

и

вычисляют соответственно по формулам:

Для

контроля вычислений целесообразно убедиться, что сумма вероятностей условного

распределения равна единице.

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Ковариация (корреляционный момент)

Ковариация двух случайных величин характеризует степень зависимости случайных величин, так

и их рассеяние вокруг точки

.

Ковариацию

(корреляционный момент) можно найти по формуле:

Свойства ковариации

Свойство 1.

Ковариация двух независимых случайных величин равна нулю.

Свойство 2.

Ковариация двух случайных величин равна математическому ожиданию их

произведение математических ожиданий.

Свойство 3.

Ковариация двухмерной случайной величины по абсолютной случайной величине не

превосходит среднеквадратических отклонений своих компонентов.

Коэффициент корреляции

Коэффициент корреляции – отношение ковариации двухмерной случайной

величины к произведению среднеквадратических отклонений.

Формула коэффициента корреляции:

Две

случайные величины

и

называют коррелированными, если их коэффициент

корреляции отличен от нуля.

и

называют некоррелированными величинами, если

их коэффициент корреляции равен нулю

Свойства коэффициента корреляции

Свойство 1.

Коэффициент корреляции двух независимых случайных величин равен нулю. Отметим,

что обратное утверждение неверно.

Свойство 2.

Коэффициент корреляции двух случайных величин не превосходит по абсолютной

величине единицы.

Свойство 3.

Коэффициент корреляции двух случайных величин равен по модулю единице тогда и

только тогда, когда между величинами существует линейная функциональная

зависимость.

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Линейная регрессия

Рассмотрим

двумерную случайную величину

, где

и

– зависимые случайные величины. Представим

одну из величины как функцию другой. Ограничимся приближенным представлением

величины

в виде линейной функции величины

:

где

и

– параметры, подлежащие определению. Это можно

сделать различными способами и наиболее употребительный из них – метод

наименьших квадратов.

Линейная

средняя квадратическая регрессия

на

имеет вид:

Коэффициент

называют

коэффициентом регрессии

на

, а прямую

называют

прямой среднеквадратической регрессии

на

.

Аналогично

можно получить прямую среднеквадратической регрессии

на

:

Смежные темы решебника:

- Двумерная непрерывная случайная величина

- Линейный выборочный коэффициент корреляции

- Парная линейная регрессия и метод наименьших квадратов

Задача 1

Закон

распределения дискретной двумерной случайной величины (X,Y) задан таблицей.

Требуется:

—

определить одномерные законы распределения случайных величин X и Y;

— найти

условные плотности распределения вероятностей величин;

—

вычислить математические ожидания mx и my;

—

вычислить дисперсии σx и σy;

—

вычислить ковариацию μxy;

—

вычислить коэффициент корреляции rxy.

| xy | 3 | 5 | 8 | 10 | 12 |

| -1 | 0.04 | 0.04 | 0.03 | 0.03 | 0.01 |

| 1 | 0.04 | 0.07 | 0.06 | 0.05 | 0.03 |

| 3 | 0.05 | 0.08 | 0.09 | 0.08 | 0.05 |

| 6 | 0.03 | 0.04 | 0.04 | 0.06 | 0.08 |

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 2

Задана

дискретная двумерная случайная величина (X,Y).

а) найти

безусловные законы распределения составляющих; б) построить регрессию случайной

величины Y на X; в) построить регрессию случайной величины X на Y; г) найти коэффициент ковариации; д) найти

коэффициент корреляции.

| Y | X | ||||

| 1 | 2 | 3 | 4 | 5 | |

| 30 | 0.05 | 0.03 | 0.02 | 0.01 | 0.01 |

| 40 | 0.03 | 0.02 | 0.02 | 0.04 | 0.01 |

| 50 | 0.05 | 0.03 | 0.02 | 0.02 | 0.01 |

| 70 | 0.1 | 0.03 | 0.04 | 0.03 | 0.01 |

| 90 | 0.1 | 0.04 | 0.01 | 0.07 | 0.2 |

Задача 3

Двумерная случайная величина (X,Y) задана

таблицей распределения. Найти законы распределения X и Y, условные

законы, регрессию и линейную регрессию Y на X.

|

x y |

1 | 2 | 3 |

| 1.5 | 0.03 | 0.02 | 0.02 |

| 2.9 | 0.06 | 0.13 | 0.03 |

| 4.1 | 0.4 | 0.07 | 0.02 |

| 5.6 | 0.15 | 0.06 | 0.01 |

Задача 4

Двумерная

случайная величина (X,Y) распределена по закону

| XY | 1 | 2 |

| -3 | 0,1 | 0,2 |

| 0 | 0,2 | 0,3 |

| -3 | 0 | 0,2 |

Найти

законы распределения случайных величины X и Y, условный закон

распределения Y при X=0 и вычислить ковариацию.

Исследовать зависимость случайной величины X и Y.

Задача 5

Случайные

величины ξ и η имеют следующий совместный закон распределения:

P(ξ=1,η=1)=0.14

P(ξ=1,η=2)=0.18

P(ξ=1,η=3)=0.16

P(ξ=2,η=1)=0.11

P(ξ=2,η=2)=0.2

P(ξ=2,η=3)=0.21

1)

Выписать одномерные законы распределения случайных величин ξ и η, вычислить

математические ожидания Mξ, Mη и дисперсии Dξ, Dη.

2) Найти

ковариацию cov(ξ,η) и коэффициент корреляции ρ(ξ,η).

3)

Выяснить, зависимы или нет события {η=1} и {ξ≥η}

4)

Составить условный закон распределения случайной величины γ=(ξ|η≥2) и найти Mγ и

Dγ.

Задача 6

Дан закон

распределения двумерной случайной величины (ξ,η):

| ξ=-1 | ξ=0 | ξ=2 | |

| η=1 | 0,1 | 0,1 | 0,1 |

| η=2 | 0,1 | 0,2 | 0,1 |

| η=3 | 0,1 | 0,1 | 0,1 |

1) Выписать одномерные законы

распределения случайных величин ξ и η, вычислить математические ожидания Mξ,

Mη и дисперсии Dξ, Dη

2) Найти ковариацию cov(ξ,η) и

коэффициент корреляции ρ(ξ,η).

3) Являются ли случайные события |ξ>0|

и |η> ξ | зависимыми?

4) Составить условный закон

распределения случайной величины γ=(ξ|η>0) и найти Mγ и Dγ.

Задача 7

Дано

распределение случайного вектора (X,Y). Найти ковариацию X и Y.

| XY | 1 | 2 | 4 |

| -2 | 0,25 | 0 | 0,25 |

| 1 | 0 | 0,25 | 0 |

| 3 | 0 | 0,25 | 0 |

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 8

Случайные

приращения цен акций двух компаний за день имеют совместное распределение,

заданное таблицей. Найти ковариацию этих случайных величин.

| YX | -1 | 1 |

| -1 | 0,4 | 0,1 |

| 1 | 0,2 | 0,3 |

Задача 9

Найдите

ковариацию Cov(X,Y) для случайного дискретного вектора (X,Y),

распределенного по закону:

| X=-3 | X=0 | X=1 | |

| Y=-2 | 0,3 | ? | 0,1 |

| Y=1 | 0,1 | 0,1 | 0,2 |

Задача 10

Совместный

закон распределения пары

задан таблицей:

| xh | -1 | 0 | 1 |

| -1 | 1/12 | 1/4 | 1/6 |

| 1 | 1/4 | 1/12 | 1/6 |

Найти

закон распределения вероятностей случайной величины xh и вычислить cov(2x-3h,x+2h).

Исследовать вопрос о зависимости случайных величин x и h.

Задача 11

Составить двумерный закон распределения случайной

величины (X,Y), если известны законы независимых составляющих. Чему равен коэффициент

корреляции rxy?

| X | 20 | 25 | 30 | 35 |

| P | 0.1 | 0.1 | 0.4 | 0.4 |

и

Задача 12

Задано

распределение вероятностей дискретной двумерной случайной величины (X,Y):

| XY | 0 | 1 | 2 |

| -1 | ? | 0,1 | 0,2 |

| 1 | 0,1 | 0,2 | 0,3 |

На сайте можно заказать решение контрольной или самостоятельной работы, домашнего задания, отдельных задач. Для этого вам нужно только связаться со мной:

ВКонтакте

WhatsApp

Telegram

Мгновенная связь в любое время и на любом этапе заказа. Общение без посредников. Удобная и быстрая оплата переводом на карту СберБанка. Опыт работы более 25 лет.

Подробное решение в электронном виде (docx, pdf) получите точно в срок или раньше.

Задача 13

Совместное

распределение двух дискретных случайных величин ξ и η задано таблицей:

| ξη | -1 | 1 | 2 |

| 0 | 1/7 | 2/7 | 1/7 |

| 1 | 1/7 | 1/7 | 1/7 |

Вычислить

ковариацию cov(ξ-η,η+5ξ). Зависимы ли ξ и η?

Задача 14

Рассчитать

коэффициенты ковариации и корреляции на основе заданного закона распределения

двумерной случайной величины и сделать выводы о тесноте связи между X и Y.

| XY | 2,3 | 2,9 | 3,1 | 3,4 |

| 0,2 | 0,15 | 0,15 | 0 | 0 |

| 2,8 | 0 | 0,25 | 0,05 | 0,01 |

| 3,3 | 0 | 0,09 | 0,2 | 0,1 |

Задача 15

Задан

закон распределения случайного вектора (ξ,η). Найдите ковариацию (ξ,η)

и коэффициент корреляции случайных величин.

| xy | 1 | 4 |

| -10 | 0,1 | 0,2 |

| 0 | 0,3 | 0,1 |

| 20 | 0,2 | 0,1 |

Задача 16

Для

случайных величин, совместное распределение которых задано таблицей

распределения. Найти:

а) законы

распределения ее компонент и их числовые характеристики;

b) условные законы распределения СВ X при условии Y=b и СВ Y при

условии X=a, где a и b – наименьшие значения X и Y.

с)

ковариацию и коэффициент корреляции случайных величин X и Y;

d) составить матрицу ковариаций и матрицу корреляций;

e) вероятность попадания в область, ограниченную линиями y=16-x2 и y=0.

f) установить, являются ли случайные величины X и Y зависимыми;

коррелированными.

| XY | -1 | 0 | 1 | 2 |

| -1 | 0 | 1/6 | 0 | 1/12 |

| 0 | 1/18 | 1/9 | 1/12 | 1/9 |

| 2 | 1/6 | 0 | 1/9 | 1/9 |

Задача 17

Совместный

закон распределения случайных величин X и Y задан таблицей:

|

XY |

0 |

1 |

3 |

|

0 |

0,15 |

0,05 |

0,3 |

|

-1 |

0 |

0,15 |

0,1 |

|

-2 |

0,15 |

0 |

0,1 |

Найдите:

а) закон

распределения случайной величины X и закон распределения

случайной величины Y;

б) EX, EY, DX, DY, cov(2X+3Y, X-Y), а

также математическое ожидание и дисперсию случайной величины V=6X-8Y+3.

Задача 18

Известен

закон распределения двумерной случайной величины (X,Y).

а) найти

законы распределения составляющих и их числовые характеристики (M[X],D[X],M[Y],D[Y]);

б)

составить условные законы распределения составляющих и вычислить

соответствующие мат. ожидания;

в)

построить поле распределения и линию регрессии Y по X и X по Y;

г)

вычислить корреляционный момент (коэффициент ковариации) μxy и

коэффициент корреляции rxy.

|

|

5 | 20 | 35 |

| 100 | — | — | 0.05 |

| 115 | — | 0.2 | 0.15 |

| 130 | 0.15 | 0.35 | — |

| 145 | 0.1 | — | —- |

Содержание:

- Случайные векторы

- Свойства функции распределения случайного вектора

- Двумерные дискретные случайные векторы

- Двумерные абсолютно непрерывные случайные векторы

- Сходимость случайных величин

Случайные векторы

Рассматриваем случайное явление и вероятностное пространство, которое отвечает этому случайному явлению. Пусть

Определение. Функцией распределения случайного вектора

Свойства функции распределения случайного вектора

1. Функция распределения непрерывна слева и монотонно неубывающая по всем аргументам.

2.

3.

4.

5. Функция распределения компоненты

Определение. Случайный вектор

Очевидно, что каждая компонента этого случайного вектора является дискретной случайной величиной.

Дискретный случайный вектор определяется значениями, которые он приобретает, и вероятностями, с которыми приобретаются эти значения.

Далее будем считать, что компонента ξ1 приобретает значения

Определение. Случайный вектор

Определение. Компоненты случайного вектора

Если случайный вектор является дискретным, то условие независимости конкретизируется так:

Для абсолютно непрерывного случайного вектора условие независимости является таким:

Пусть

Если случайный вектор является дискретным и

если вектор ξ – абсолютно непрерывный.

Определение. Ковариантной матрицей случайного вектора

где

и если

Понятно, что на диагоналях стоят дисперсии соответствующих компонент.

Легко видеть, что

Доказательство.

Коэффициентом корреляции компонент

корреляционной матрицей является матрица

Детальнее свойства случайных векторов рассмотрим для двумерного случая.

Двумерные дискретные случайные векторы

Рассматриваем двумерный случайный вектор

Очевидно, что

где

Пример. Дано распределение двумерного случайного вектора

Найти

Решение. Поскольку

то

Пример. Дано распределение двумерного случайного вектора

Найти

Решение. Очевидно, что

Распределение компонент находится так:

Далее определяем

Пример. Дано распределение двумерного случайного вектора

Найти распределение компонент.

Решение.

Для контроля целесообразно сделать проверку. Известно, что

Следовательно, распределение компоненты ξ является таким:

Переходим к компоненте η:

Проверка:

Следовательно, распределение компоненты η является таким:

Заметим, что распределение компонент можно находить значительно проще.

Запишем еще раз распределение вектора, добавив одну строку снизу и один столбец справа. Далее находим суммы элементов по строкам и записываем эти суммы в последний столбец, а также находим суммы элементов по столбцах и значения найденных сумм записываем в нижнюю строку. Полученные суммы являются значениями вероятностей. Например, сумма верхней строки является вероятностью

Определение. Условным распределением компоненты ξ при условии, что

Аналогично, условным распределением компоненты η при условии, что

Условным математическим ожиданием компоненты ξ при условии, что

Аналогично, условным математическим ожиданием компоненты η при условии, что

Пример. Дано распределение дискретного случайного вектора

Найти условное распределение компоненты ξ при условии, что

Решение.

Значение вероятности

Далее

Следовательно, условное распределение компоненты ξ при условии, что

Сразу находим условное математическое ожидание компоненты ξ при условии, что

Переходим к нахождения условного распределения компоненты η при условии, что

Запишем это условное распределение в виде таблицы

Далее найдем условное математическое ожидание.

Условие независимости для двумерного дискретного случайного вектора является такой:

для произвольных

Пример. Дано распределение двумерного случайного вектора

Проверить, являются ли независимыми компоненты этого вектора.

Решение.

Очевидно, условие

Функция распределения для двумерного случайного вектора

Очевидно, что функция распределения является кусочно-постоянной на отрезках

Поскольку случайный вектор

Пример. Дано распределение двумерного случайного вектора

Найти функцию распределения.

Решение. Поскольку наименьшим значением среди

Осталось заполнить 4 строки и 3 столбца. Обозначим значения незаполненных клеточек через

Пусть

В частности ковариация находится по формуле

де

Коэффициент корреляции

Пример. Найти ковариацию и коэффициент корреляции случайного вектора

Решение. Сначала найдем распределение компонент.

Далее находим

И, наконец, находим

Переходим к коэффициенту корреляции.

Запишем ковариационную и корреляционную матрицы

Заметим, что если компоненты случайного вектора является независимыми, то ковариация, а следовательно, и коэффициент корреляции равняются нулю. Наоборот не всегда правильно.

Пример случайного вектора, у которого ковариация равна нулю и коэффициенты зависимы.

Сначала покажем, что ковариация равно нулю.

Далее проверяем компоненты на независимость

Следовательно,

Заметим, что если ковариация является ненулевой, то компоненты зависимы.

Двумерные абсолютно непрерывные случайные векторы

Рассматриваем двумерный абсолютно непрерывный вектор

Пример. Плотность двумерного случайного вектора

где область D ограничена линиями

Решение. Сначала изобразим область D.

Вероятность попадания в область

Очевидно, что

Пример. Дана плотность абсолютно непрерывного случайного вектора

Найти

Решение. Сначала найдем неизвестную константу

Сначала найдем

Далее находим вероятность

Переходим к нахождению вероятности

И, наконец находим вероятность

Как видно из рисунка, сначала нужно найти точку пересечения прямых

Условие независимости компонент проверяется так:

Пример. Дана плотность случайного вектора

где область D ограничена линиями

Решение. Прежде всего изобразим область D.

Следовательно,

Проверяем независимость компонент. Для этого находим их плотности

Следовательно,

Переходим к нахождению плотности η

Находим произведение

В области D имеем

Следовательно, условие независимости не выполняется. ■

Пример. Известно, что компоненты случайного вектора

Найти совместную плотность случайного вектора

Решение. Из условия независимости

Поэтому

где область D ограничена линиями

Функция распределения находится по определению

Пример. Дана плотность абсолютно непрерывного случайного вектора

Найти

Решение. Прежде всего находим неизвестную константу.

По определению имеем

Аналитический вид функции распределения зависит от того, где находится точка

В частности:

1. Пусть

Тогда, как видно из рисунка

2.

Тогда

3. Далее рассмотрим точки

Очевидно аналитический вид функции распределения в этом случае будет таким:

4. Далее рассматриваем множество точек

5. Наконец, если

Условная плотность

соответственно, условная плотность

Пример. Дана плотность абсолютно непрерывного случайного вектора

Найти неизвестную константу

Решение. Сначала изображаем область D и находим неизвестную постоянную.

Далее находим распределение составляющих

Следовательно, условия плотности будут такими:

Математическое ожидание от функции компонент вектора

Пример. Дана плотность абсолютно непрерывного случайного вектора

Найти ковариацию, коэффициент корреляции, ковариационную матрицу, корреляционную матрицу, если область D ограничена линиями

Решение. Сначала находим неизвестную константу

Переходим к ковариации

Следовательно,

Далее находим дисперсии

Ковариационная матрица является такой:

Корреляционная матрица имеет вид

Сходимость случайных величин

Определение. Рассматриваем последовательность случайных величин

или

и это обозначают

Определение. Последовательность случайных величин

Это обозначают

Теорема. Если

Закон больших чисел

Рассматриваем последовательность случайных величин

Сходимость по вероятности всегда проверять нет смысла, потому что есть теоремы, которые являются достаточными условиями для выполнения закона больших чисел.

Теорема Чебышева. Пусть дана последовательность независимых случайных величин

Теорема Хинчина. Пусть дана последовательность независимых одинаково распределенных случайных величин

Теорема Маркова. Пусть дана последовательность произвольных случайных величин

Тогда для этой последовательности выполняется закон больших чисел.

Теорема Бернулли. В схеме независимых испытаний

Пример. Дана последовательность независимых случайных величин

Проверить, выполняется ли для этой последовательности закон больших чисел.

Решение. Для проверки используем теорему Чебышева. Независимость дана в условии.

Очевидно, что

Поэтому для данной последовательности выполняются условия теоремы Чебышева, а следовательно, выполняется закон больших чисел. ■

Пример. Дана последовательность независимых случайных величин, которые имеют распределение Коши. Проверить, выполняется ли для этой последовательности закон больших чисел

Решение. Поскольку для распределения Коши не существует математического ожидания, то речь не идет о выполнении закона больших чисел. ■

Лекции:

- Биномиальный закон

- Равномерный закон

- Закон Пуассона

- Показательный закон

- Нормальный закон

- Теория вероятности: формулы, примеры

- Схема Бернулли теория вероятности

- Формула Пуассона теория вероятности

- Формула лапласа

- Статистическая вероятность

| Определение: |

Пусть — две случайные величины, определённые на одном и том же вероятностном пространстве. Тогда ковариацией случайных величин (англ. covariance) и называется выражение следующего вида:

|

Содержание

- 1 Вычисление

- 2 Свойства ковариации

- 3 Неравенство Коши — Буняковского

- 4 Матрица ковариаций

- 5 Расстояние Махаланобиса

- 6 См. также

- 7 Источники информации

Вычисление

В силу линейности математического ожидания, ковариация может быть записана как:

Итого,

Свойства ковариации

- Ковариация симметрична:

- .

- Пусть случайные величины, а их две произвольные линейные комбинации. Тогда

- .

- Ковариация случайной величины с собой равна её дисперсии:

- .

| Утверждение: |

|

Если , то и не обязательно являются независимыми |

Неравенство Коши — Буняковского

| Утверждение: |

|

Докажем три аксиомы скалярного произведения:

удовлетвотряет трем аксиомам, а значит можно использовать в качестве скалярного произведения. |

| Теорема (неравенство Коши — Буняковского): |

|

Если принять в качестве скалярного произведения двух случайных величин ковариацию , то квадрат нормы случайной величины будет равен дисперсии и неравенство Коши-Буняковского запишется в виде:

|

| Доказательство: |

|

Для этого предположим, что — некоторое вещественное число, и рассмотрим очевидное неравенство , где и . Используя линейность математического ожидания, мы получаем такое неравенство: Обратим внимание, что левая часть является квадратным трехчленом, зависимым от . Мы имеем: , и Итак, наш квадратный трехчлен выглядит следующим образом: Для того, чтобы неравенство выполнялось для всех значений , дискриминант должен быть неположительным, то есть: |

Матрица ковариаций

Матрица ковариаций (англ. covariance matrix) — это матрица, элементы которой являются попарными ковариациями элементов одного или двух случайных векторов.

Ковариационная матрица случайного вектора — квадратная симметрическая неотрицательно определенная матрица, на диагонали которой располагаются дисперсии компонент вектора, а внедиагональные элементы — ковариации между компонентами.

| Определение: |

| Пусть — случайные вектора размерности и соответственно. — случайные величины. Тогда матрицей ковариаций векторов называется

|

Например, ковариационная матрица для случайного вектора выглядит следующим образом:

Замечание

- Если , то называется матрицей ковариации вектора и обозначается как — вариация (дисперсия) случайного вектора.

Свойства

- Матрица ковариации случайного вектора неотрицательно определена:

- Перестановка аргументов:

- Матрица ковариации аддитивна по каждому аргументу:

- Если , то

Расстояние Махаланобиса

Расстояние Махаланобиса (англ. Mahalanobis distance) — мера расстояния между векторами случайных величин, обобщающая понятие евклидова расстояния.

| Определение: |

| Пусть — многомерный вектор, — матрица ковариации, тогда расстояние Махаланобиса от до множества со средним значением определяется как |

Расстояние Махаланобиса двух случайных векторов с матрицей ковариации — это мера различия между ними.

Замечание

- Если матрица ковариации равняется единичной матрице, то расстояние Махалонобиса равняется расстоянию Евклида.

См. также

- Корреляция случайных величин

- Дисперсия случайной величины

Источники информации

- НГУ — Ковариация двух случайных величин

- Википедия — Ковариация

- Википедия — Матрица ковариации

- Википедия — Расстояние Махалонобиса

- Википедия — неравенство Коши — Буняковского (доказательство)

46

Случайный вектор

— это упорядоченный набор (система)

случайных величин. Ранее уже встречались

наборы независимых случайных величин.

В этой главе рассматриваются системы

случайных величин, зависящих друг от

друга. Примеры случайных векторов:

вектор скорости зенитной ракеты,

наводимой на цель, совершающей

противоракетный маневр; вектор состояния

реальной атмосферы (температура,

давление, плотность, влажность, направление

и скорость ветра); вектор свойств

конструкционного материала (плотность,

временное сопротивление , модуль

упругости и пр.).

4.1. Ковариация

Ковариацией двух

скалярных случайных величин X

и Y

называется математическое ожидание

произведения центрированных X

и Y.

Слово ковариация

происходит от латинского co

— вместе и

variatio

– изменение.

Здесь и далее нулем

отмечены центрированные случайные

величины.

Если X

и Y

— непрерывные случайные величины, то

(4.1)

где

— плотность совместного распределения

случайных величин.

За характеристику

линейной зависимости между X

и Y

применяется отношение ковариации к

произведению средних квадратических

отклонений называемое коэффициентом

корреляции

Ковариация и

коэффициент корреляции независимых

случайных величин равны нулю. Если X

= Y,

то

ЕслиX

= —Y,

то

Величина ковариации

обычно устанавливается опытным путем.

Статистическая оценка ковариации

находится по соотношениям

Обработка опытных

данных должна включать также оценку

точности определения ковариации.

4.2. Математическое ожидание и ковариационная матрица случайного вектора

Как правило, под

вектором будем понимать матрицу-столбец

Учтем, что

математическое ожидание матрицы равно

матрице, составленной из математических

ожиданий ее элементов.

Ковариационной

матрицей случайного вектора называется

матрица, составленная из дисперсий и

ковариаций проекций вектора.

Ковариационная

матрица симметрична относительно

главной диагонали так как

.

Это означает, что.

4.3. Линейное преобразование случайного вектора

Из определения

математического ожидания следует, что

Здесь A,B,C — неслучайные

матрицы, структура которых допускает

приведенные операции сложения и

умножения.

Для линейного

преобразования случайного вектора

справедливо

следующее

Действительно

Последний результат

очень важен и будет часто использоваться.

4.4. Собственные векторы ковариационной матрицы

Как следует из

4.2, случайный вектор X

с m

компонентами имеет квадратную и

симметричную относительно главной

диагонали ковариационную матрицу

K порядка m.

Вектор Z

и переменная

называются собственным вектором и

собственным значением матрицы, если

они удовлетворяют равенству

,

(4.3)

из которого следует,

что умножение собственного вектора

слева на матрицу K

изменяет его модуль, но не изменяет

направления.

Перепишем приведенное

равенство в виде однородной системы

линейных уравнений

(4.4)

Здесь E

— единичная матрица порядка m.

Отличное от нуля решение этой системы

существует только тогда, когда определитель

системы равен нулю.

Это уравнение

степени m

относительно неизвестной

.

Оно называется характеристическим

уравнением матрицы. Доказано, что если

матрица вещественна и симметрична, то

все ееm

корней

— вещественны и различны. Подстановка

собственных значений матрицы в исходную

систему уравнений (4.4) дает возможность

определить собственные векторы

Собственные векторы

ортогональны, то есть

Для доказательства

этого важного свойства составим

произведение

и раскроем его двумя различными способами,

используя равенство (4.3). Во-первых,

Во-вторых,

Поскольку

,

полученные выражения равны только при

условии ортогональности векторов.

Система (4.4)

определяет лишь направление, но не длину

(модуль) собственных векторов. Действительно

вектор W=CZ,

отличающийся от собственного вектора

только длиной, также удовлетворяет

равенству (4.4).

.

Поэтому будем

считать, что модуль каждого собственного

вектора равен единице

Образуем из векторов

Z

квадратную матрицу F

порядка m:

F

Как установлено,

столбцы этой матрицы, во-первых,

ортогональны, а во-вторых, нормированы.

Установим еще одно

свойство матрицы F. Умножим матрицу F

слева на матрицу F транспонированную и

раскроем произведение.

Таким

образом, транспонирование матрицы F

одновременно является операцией

обращения:

В заключение, не

смотря на очевидность, подчеркнем, что

также как сама ковариационная матрица

случайного вектора, ее собственные

векторы и собственные значения неслучайны.

Соседние файлы в папке MD_DOC

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

- #

Sample points from a bivariate Gaussian distribution with a standard deviation of 3 in roughly the lower left–upper right direction and of 1 in the orthogonal direction. Because the x and y components co-vary, the variances of

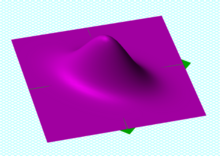

In probability theory and statistics, a covariance matrix (also known as auto-covariance matrix, dispersion matrix, variance matrix, or variance–covariance matrix) is a square matrix giving the covariance between each pair of elements of a given random vector. Any covariance matrix is symmetric and positive semi-definite and its main diagonal contains variances (i.e., the covariance of each element with itself).

Intuitively, the covariance matrix generalizes the notion of variance to multiple dimensions. As an example, the variation in a collection of random points in two-dimensional space cannot be characterized fully by a single number, nor would the variances in the

The covariance matrix of a random vector

Definition[edit]

Throughout this article, boldfaced unsubscripted

If the entries in the column vector

are random variables, each with finite variance and expected value, then the covariance matrix

where the operator

Conflicting nomenclatures and notations[edit]

Nomenclatures differ. Some statisticians, following the probabilist William Feller in his two-volume book An Introduction to Probability Theory and Its Applications,[2] call the matrix

Both forms are quite standard, and there is no ambiguity between them. The matrix

By comparison, the notation for the cross-covariance matrix between two vectors is

Properties[edit]

Relation to the autocorrelation matrix[edit]

The auto-covariance matrix

where the autocorrelation matrix is defined as ![{displaystyle operatorname {R} _{mathbf {X} mathbf {X} }=operatorname {E} [mathbf {X} mathbf {X} ^{rm {T}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/375369663d22bba80d770f6374289f95dd22cf63)

Relation to the correlation matrix[edit]

An entity closely related to the covariance matrix is the matrix of Pearson product-moment correlation coefficients between each of the random variables in the random vector

where

Equivalently, the correlation matrix can be seen as the covariance matrix of the standardized random variables

Each element on the principal diagonal of a correlation matrix is the correlation of a random variable with itself, which always equals 1. Each off-diagonal element is between −1 and +1 inclusive.

Inverse of the covariance matrix[edit]

The inverse of this matrix,

Just as the covariance matrix can be written as the rescaling of a correlation matrix by the marginal variances:

So, using the idea of partial correlation, and partial variance, the inverse covariance matrix can be expressed analogously:

This duality motivates a number of other dualities between marginalizing and conditioning for gaussian random variables.

Basic properties[edit]

For ![{displaystyle operatorname {K} _{mathbf {X} mathbf {X} }=operatorname {var} (mathbf {X} )=operatorname {E} left[left(mathbf {X} -operatorname {E} [mathbf {X} ]right)left(mathbf {X} -operatorname {E} [mathbf {X} ]right)^{rm {T}}right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bed55fb51d1aad5b83b37076bdbd9ad0177a813b)

![{displaystyle mathbf {mu _{X}} =operatorname {E} [{textbf {X}}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/25987aa171cbd6ec023a92eb06b6ee750de39309)

is positive-semidefinite, i.e.

is symmetric, i.e.

- For any constant (i.e. non-random)

matrix

and constant

vector

, one has

- If

is another random vector with the same dimension as

, then

where

is the cross-covariance matrix of

and

.

Block matrices[edit]

The joint mean

where

If

then the conditional distribution for

[5]

defined by conditional mean

and conditional variance

The matrix

The matrix of regression coefficients may often be given in transpose form,

Partial covariance matrix[edit]

A covariance matrix with all non-zero elements tells us that all the individual random variables are interrelated. This means that the variables are not only directly correlated, but also correlated via other variables indirectly. Often such indirect, common-mode correlations are trivial and uninteresting. They can be suppressed by calculating the partial covariance matrix, that is the part of covariance matrix that shows only the interesting part of correlations.

If two vectors of random variables

The partial covariance matrix

Covariance matrix as a parameter of a distribution[edit]

If a column vector

where ![{displaystyle mathbf {mu =operatorname {E} [X]} }](https://wikimedia.org/api/rest_v1/media/math/render/svg/d9c821aa85a1cbc2edfffb9343c51c7cd3541b34)

Covariance matrix as a linear operator[edit]

Applied to one vector, the covariance matrix maps a linear combination c of the random variables X onto a vector of covariances with those variables:

Similarly, the (pseudo-)inverse covariance matrix provides an inner product

Which matrices are covariance matrices?[edit]

From the identity just above, let

which must always be nonnegative, since it is the variance of a real-valued random variable, so a covariance matrix is always a positive-semidefinite matrix.

The above argument can be expanded as follows:

where the last inequality follows from the observation that ![{displaystyle w^{rm {T}}(mathbf {X} -operatorname {E} [mathbf {X} ])}](https://wikimedia.org/api/rest_v1/media/math/render/svg/127bb7293f5d9738d76b0c9461d4236befd8dccb)

Conversely, every symmetric positive semi-definite matrix is a covariance matrix. To see this, suppose

Complex random vectors[edit]

The variance of a complex scalar-valued random variable with expected value

where the complex conjugate of a complex number

If

,

The matrix so obtained will be Hermitian positive-semidefinite,[8] with real numbers in the main diagonal and complex numbers off-diagonal.

- Properties

- The covariance matrix is a Hermitian matrix, i.e.

.[1]: p. 179

- The diagonal elements of the covariance matrix are real.[1]: p. 179

Pseudo-covariance matrix[edit]

For complex random vectors, another kind of second central moment, the pseudo-covariance matrix (also called relation matrix) is defined as follows:

In contrast to the covariance matrix defined above, Hermitian transposition gets replaced by transposition in the definition.

Its diagonal elements may be complex valued; it is a complex symmetric matrix.

Estimation[edit]

If

or, if the row means were known a priori,

These empirical sample covariance matrices are the most straightforward and most often used estimators for the covariance matrices, but other estimators also exist, including regularised or shrinkage estimators, which may have better properties.

Applications[edit]

The covariance matrix is a useful tool in many different areas. From it a transformation matrix can be derived, called a whitening transformation, that allows one to completely decorrelate the data[citation needed] or, from a different point of view, to find an optimal basis for representing the data in a compact way[citation needed] (see Rayleigh quotient for a formal proof and additional properties of covariance matrices).

This is called principal component analysis (PCA) and the Karhunen–Loève transform (KL-transform).

The covariance matrix plays a key role in financial economics, especially in portfolio theory and its mutual fund separation theorem and in the capital asset pricing model. The matrix of covariances among various assets’ returns is used to determine, under certain assumptions, the relative amounts of different assets that investors should (in a normative analysis) or are predicted to (in a positive analysis) choose to hold in a context of diversification.

Use in optimization[edit]

The evolution strategy, a particular family of Randomized Search Heuristics, fundamentally relies on a covariance matrix in its mechanism. The characteristic mutation operator draws the update step from a multivariate normal distribution using an evolving covariance matrix. There is a formal proof that the evolution strategy’s covariance matrix adapts to the inverse of the Hessian matrix of the search landscape, up to a scalar factor and small random fluctuations (proven for a single-parent strategy and a static model, as the population size increases, relying on the quadratic approximation).[9]

Intuitively, this result is supported by the rationale that the optimal covariance distribution can offer mutation steps whose equidensity probability contours match the level sets of the landscape, and so they maximize the progress rate.

Covariance mapping[edit]

In covariance mapping the values of the

In practice the column vectors

where

and the covariance matrix is estimated by the sample covariance matrix

where the angular brackets denote sample averaging as before except that the Bessel’s correction should be made to avoid bias. Using this estimation the partial covariance matrix can be calculated as

where the backslash denotes the left matrix division operator, which bypasses the requirement to invert a matrix and is available in some computational packages such as Matlab.[10]

Figure 1: Construction of a partial covariance map of N2 molecules undergoing Coulomb explosion induced by a free-electron laser.[11] Panels a and b map the two terms of the covariance matrix, which is shown in panel c. Panel d maps common-mode correlations via intensity fluctuations of the laser. Panel e maps the partial covariance matrix that is corrected for the intensity fluctuations. Panel f shows that 10% overcorrection improves the map and makes ion-ion correlations clearly visible. Owing to momentum conservation these correlations appear as lines approximately perpendicular to the autocorrelation line (and to the periodic modulations which are caused by detector ringing).

Fig. 1 illustrates how a partial covariance map is constructed on an example of an experiment performed at the FLASH free-electron laser in Hamburg.[11] The random function

In the example of Fig. 1 spectra

Two-dimensional infrared spectroscopy[edit]

Two-dimensional infrared spectroscopy employs correlation analysis to obtain 2D spectra of the condensed phase. There are two versions of this analysis: synchronous and asynchronous. Mathematically, the former is expressed in terms of the sample covariance matrix and the technique is equivalent to covariance mapping.[12]

See also[edit]

- Covariance function

- Multivariate statistics

- Lewandowski-Kurowicka-Joe distribution

- Gramian matrix

- Eigenvalue decomposition

- Quadratic form (statistics)

- Principal components

References[edit]

- ^ a b c Park,Kun Il (2018). Fundamentals of Probability and Stochastic Processes with Applications to Communications. Springer. ISBN 978-3-319-68074-3.

- ^ William Feller (1971). An introduction to probability theory and its applications. Wiley. ISBN 978-0-471-25709-7. Retrieved 10 August 2012.

- ^ Wasserman, Larry (2004). All of Statistics: A Concise Course in Statistical Inference. ISBN 0-387-40272-1.

- ^ Taboga, Marco (2010). «Lectures on probability theory and mathematical statistics».

- ^ Eaton, Morris L. (1983). Multivariate Statistics: a Vector Space Approach. John Wiley and Sons. pp. 116–117. ISBN 0-471-02776-6.

- ^ a b W J Krzanowski «Principles of Multivariate Analysis» (Oxford University Press, New York, 1988), Chap. 14.4; K V Mardia, J T Kent and J M Bibby «Multivariate Analysis (Academic Press, London, 1997), Chap. 6.5.3; T W Anderson «An Introduction to Multivariate Statistical Analysis» (Wiley, New York, 2003), 3rd ed., Chaps. 2.5.1 and 4.3.1.

- ^ Lapidoth, Amos (2009). A Foundation in Digital Communication. Cambridge University Press. ISBN 978-0-521-19395-5.

- ^ Brookes, Mike. «The Matrix Reference Manual».

- ^ Shir, O.M.; A. Yehudayoff (2020). «On the covariance-Hessian relation in evolution strategies». Theoretical Computer Science. Elsevier. 801: 157–174. doi:10.1016/j.tcs.2019.09.002.

- ^ L J Frasinski «Covariance mapping techniques» J. Phys. B: At. Mol. Opt. Phys. 49 152004 (2016), open access

- ^ a b O Kornilov, M Eckstein, M Rosenblatt, C P Schulz, K Motomura, A Rouzée, J Klei, L Foucar, M Siano, A Lübcke, F. Schapper, P Johnsson, D M P Holland, T Schlatholter, T Marchenko, S Düsterer, K Ueda, M J J Vrakking and L J Frasinski «Coulomb explosion of diatomic molecules in intense XUV fields mapped by partial covariance» J. Phys. B: At. Mol. Opt. Phys. 46 164028 (2013), open access

- ^ I Noda «Generalized two-dimensional correlation method applicable to infrared, Raman, and other types of spectroscopy» Appl. Spectrosc. 47 1329–36 (1993)

Further reading[edit]

- «Covariance matrix», Encyclopedia of Mathematics, EMS Press, 2001 [1994]

- «Covariance Matrix Explained With Pictures», an easy way to visualize covariance matrices!

- Weisstein, Eric W. «Covariance Matrix». MathWorld.

- van Kampen, N. G. (1981). Stochastic processes in physics and chemistry. New York: North-Holland. ISBN 0-444-86200-5.

![{displaystyle operatorname {K} _{X_{i}X_{j}}=operatorname {cov} [X_{i},X_{j}]=operatorname {E} [(X_{i}-operatorname {E} [X_{i}])(X_{j}-operatorname {E} [X_{j}])]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/83bec85f5e2cab5d3406677dd806e554a442331f)

![{displaystyle operatorname {var} (mathbf {X} )=operatorname {cov} (mathbf {X} ,mathbf {X} )=operatorname {E} left[(mathbf {X} -operatorname {E} [mathbf {X} ])(mathbf {X} -operatorname {E} [mathbf {X} ])^{rm {T}}right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92051943c03f3ff5b282d8090e65118c40ca400b)

![{displaystyle operatorname {cov} (mathbf {X} ,mathbf {Y} )=operatorname {K} _{mathbf {X} mathbf {Y} }=operatorname {E} left[(mathbf {X} -operatorname {E} [mathbf {X} ])(mathbf {Y} -operatorname {E} [mathbf {Y} ])^{rm {T}}right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1112b836c2cd9fde4ac076a44dfdbd213395a56b)

![{displaystyle operatorname {K} _{mathbf {X} mathbf {X} }=operatorname {E} [(mathbf {X} -operatorname {E} [mathbf {X} ])(mathbf {X} -operatorname {E} [mathbf {X} ])^{rm {T}}]=operatorname {R} _{mathbf {X} mathbf {X} }-operatorname {E} [mathbf {X} ]operatorname {E} [mathbf {X} ]^{rm {T}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/00175de2c055b834a6f012910f7a5a3d1ed96353)

![{displaystyle operatorname {corr} (mathbf {X} )={begin{bmatrix}1&{frac {operatorname {E} [(X_{1}-mu _{1})(X_{2}-mu _{2})]}{sigma (X_{1})sigma (X_{2})}}&cdots &{frac {operatorname {E} [(X_{1}-mu _{1})(X_{n}-mu _{n})]}{sigma (X_{1})sigma (X_{n})}}\\{frac {operatorname {E} [(X_{2}-mu _{2})(X_{1}-mu _{1})]}{sigma (X_{2})sigma (X_{1})}}&1&cdots &{frac {operatorname {E} [(X_{2}-mu _{2})(X_{n}-mu _{n})]}{sigma (X_{2})sigma (X_{n})}}\\vdots &vdots &ddots &vdots \\{frac {operatorname {E} [(X_{n}-mu _{n})(X_{1}-mu _{1})]}{sigma (X_{n})sigma (X_{1})}}&{frac {operatorname {E} [(X_{n}-mu _{n})(X_{2}-mu _{2})]}{sigma (X_{n})sigma (X_{2})}}&cdots &1end{bmatrix}}.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/df091a047aa8a9d829b25f68a5bbe6d56938b146)

![{displaystyle {begin{aligned}&w^{rm {T}}operatorname {E} left[(mathbf {X} -operatorname {E} [mathbf {X} ])(mathbf {X} -operatorname {E} [mathbf {X} ])^{rm {T}}right]w=operatorname {E} left[w^{rm {T}}(mathbf {X} -operatorname {E} [mathbf {X} ])(mathbf {X} -operatorname {E} [mathbf {X} ])^{rm {T}}wright]\&=operatorname {E} {big [}{big (}w^{rm {T}}(mathbf {X} -operatorname {E} [mathbf {X} ]){big )}^{2}{big ]}geq 0,end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4c9fb5265a1f97a7cc67b23c9942182f63051a73)

![{displaystyle operatorname {var} (Z)=operatorname {E} left[(Z-mu _{Z}){overline {(Z-mu _{Z})}}right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b3a3d7abfa56fdb689ebd3c01388715ad4773d4a)

![{displaystyle operatorname {K} _{mathbf {Z} mathbf {Z} }=operatorname {cov} [mathbf {Z} ,mathbf {Z} ]=operatorname {E} left[(mathbf {Z} -mathbf {mu _{Z}} )(mathbf {Z} -mathbf {mu _{Z}} )^{mathrm {H} }right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/88c60e556c5e5f705d6448f79339174ec62b1ffd)

![{displaystyle operatorname {J} _{mathbf {Z} mathbf {Z} }=operatorname {cov} [mathbf {Z} ,{overline {mathbf {Z} }}]=operatorname {E} left[(mathbf {Z} -mathbf {mu _{Z}} )(mathbf {Z} -mathbf {mu _{Z}} )^{mathrm {T} }right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bba62bd04d95107abdaa72eb5b505496ad4151ea)

![{displaystyle [mathbf {X} _{1},mathbf {X} _{2},...mathbf {X} _{n}]={begin{bmatrix}X_{1}(t_{1})&X_{2}(t_{1})&cdots &X_{n}(t_{1})\\X_{1}(t_{2})&X_{2}(t_{2})&cdots &X_{n}(t_{2})\\vdots &vdots &ddots &vdots \\X_{1}(t_{m})&X_{2}(t_{m})&cdots &X_{n}(t_{m})end{bmatrix}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/be824f93648e01daa17bd4e9d99b4398026b0149)